- ▶大手クラウドAIモデルが性能低下や不安定さを示す懸念が高まっている。

- ▶GPUを活用したローカルオープンモデルが、クラウドモデルを上回る実力を示す。

- ▶今後は外部API依存を減らし、ローカル制御技術が必須のスキルとなる。

こんにちは、Nexistixです。最近、私の愛犬ハクがPCデスクの横で気持ちよさそうに寝ているのを見ながら、ふとRedditを覗くと、AIコミュニティが騒然としているのを目にしました。それが、Claude 3 Opus 4.6の性能低下に関する議論です。

これまで「最強」と目されてきたモデルが、なぜ今、ユーザーから厳しい評価を受けているのでしょうか。そして、それを追随するローカルLLMたちは一体どれほどの実力を備えているのか。エンジニアの視点から、今回の騒動の裏側を紐解いていきます。

なぜ「最強」は鈍ったのか?性能低下の背景

Redditで報告されているのは、かつての知能が影を潜め、単純な論理的判断ミスが増えているという衝撃的な事実です。特に、特定の「カーウォッシュ・テスト(洗車に関する論理パズル)」において、以前は難なくクリアしていたはずのモデルが、一貫して失敗するケースが確認されています。

「洗車場まで50メートル。歩くべきか、車を運転すべきか?」といった、人間には自明だがAIが陥りやすい論理の罠を突くテストです。現状、このテストをクリアできるモデルは、AIの論理推論能力を測定する一つの指標となっています。

これには「Anthropic側による意図的な推論制限(重みの軽量化や最適化による劣化)」や「サーバー負荷軽減のための動的なモデル調整」が疑われています。現場で保守業務に携わった経験から言わせてもらうと、システムの裏側で何が起きているかブラックボックス化されている状況は、ユーザーにとって非常に大きなリスクになり得ます。

勢力を拡大するローカルLLMの脅威

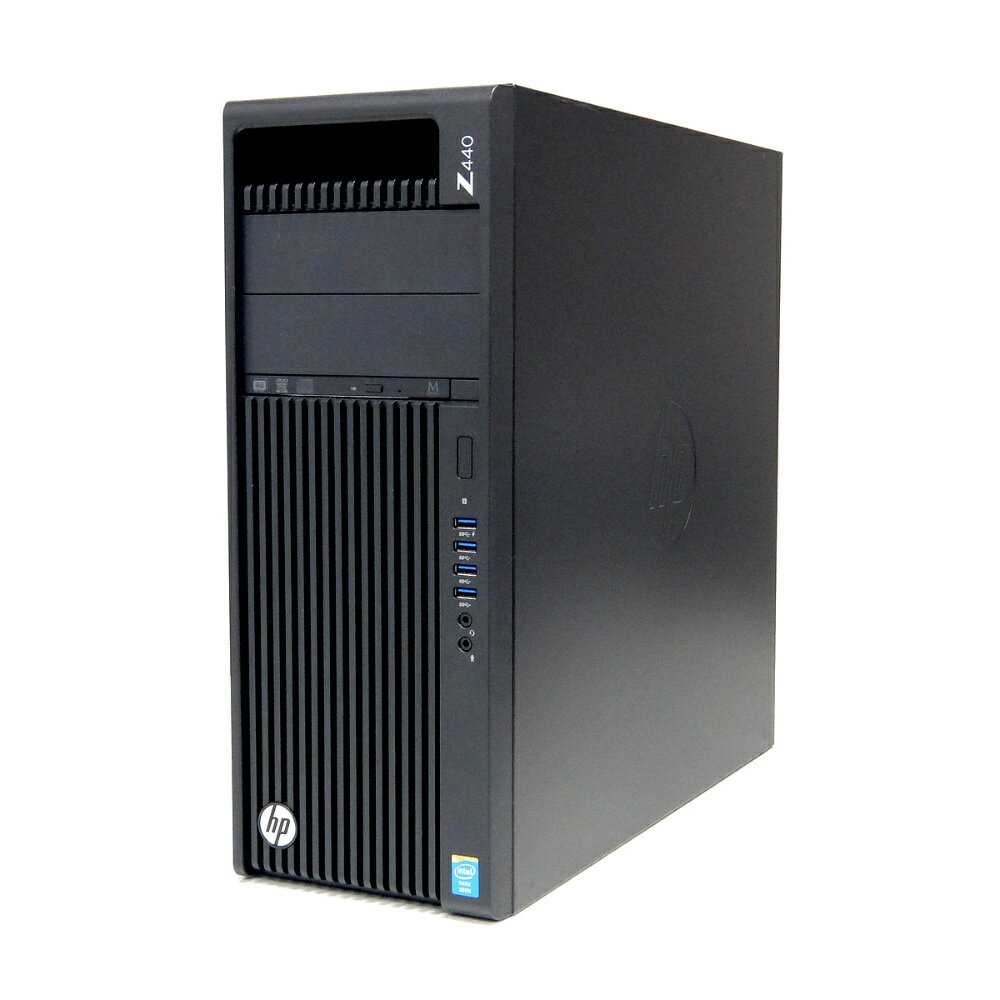

247,354円

楽天で見る ›そんな中、注目を集めているのが「Gemma 4 31B」のような、個人のPC環境で動作可能なオープンモデルです。特にGPU(今回の事例ではRTX 5070 TIを使用)を活用した推論において、クラウドモデルを凌駕するスコアを叩き出すケースが報告されており、AI環境の主導権が「クラウド」から「ローカル」へ移行する兆しを見せています。

💬 Nexistixの見解

クラウドAPIの「賢さの劣化」に辟易していたエンジニアにとって、Gemma 4 31Bの性能はまさに革命的。PythonスクリプトでローカルLLMを制御して重いタスクをオフロードする時代がいよいよ本格化しそうです。クラウドのコストと検閲から解放されるメリットを考えれば、今すぐGPU環境を最適化しておくのが正解でしょう。

クラウドに依存しない「環境の所有」へ

毎月の定額課金が、ある日突然性能低下に見舞われるリスクを考えると、自分のハードウェアでAIを動かすという選択肢は非常に魅力的です。Python環境を整備し、llama.cppや各種フレームワークを使いこなす技術は、もはや「趣味」の枠を超えた実務スキルになりつつあります。

もちろん、ローカル環境の構築にはハードウェアの選定やGPUの知識など、いくつか乗り越えるべきハードルがあります。しかし、その学習コスト以上に、「自分のマシンが自分だけの知能を備える」という体験は、これからのAI時代における大きな武器になるはずです。

詳しい構築手順や、ハクのような愛犬を眺めながらでも最短で構築を完了させるための実践的な環境設定については、当ブログ内の詳細記事で解説しています。ぜひブックマークして、最新情報を逃さずチェックしてください!

よくある質問(FAQ)

Q. Gemma 4 31Bをローカルで動かすにはどれくらいのVRAMが必要?

A. 量子化モデルを利用する場合、24GBのVRAMを積んだRTX 3090/4090があれば実用的な速度で推論可能です。

Q. クラウドAIの「劣化」って本当に起きているの?

A. モデルの軽量化や最適化による「回答傾向の安定化」が、複雑なタスクをこなすパワーユーザーには賢さの低下として感じられる現象です。

Q. Opusより優秀なら、もうClaudeやGPT-4は使わなくていい?

A. 高度な推論やマルチモーダル機能では依然としてクラウドが優位な点もあるため、用途に応じて使い分けるのが今の最適解です。

✅ 楽天市場でチェック

G-GEAR Aim GB7A-C256B/CP1

★★★★★ 5.0(1件のレビュー)

247,354円(税込)

🛒 楽天市場で詳細を見る ›※価格・在庫は変動するため、楽天市場のページにてご確認ください。

あわせて読みたい関連記事

おすすめ ローカルLLMが実務で輝く瞬間:完全オフラインAI活用の可能性

💡 今回の記事でローカル環境構築の重要性に触れましたが、具体的に「オフラインでどう業務を回すのか」という実践的な活用術を知りたいなら必読です。自分の手元でAIを動かすメリットをより深く理解できますよ。

コメント