- 約30年前のレトロ機でAIを動作させる試み

- 固定小数点演算による極限の最適化技術

- 1トークン生成に3分、技術的挑戦の結晶

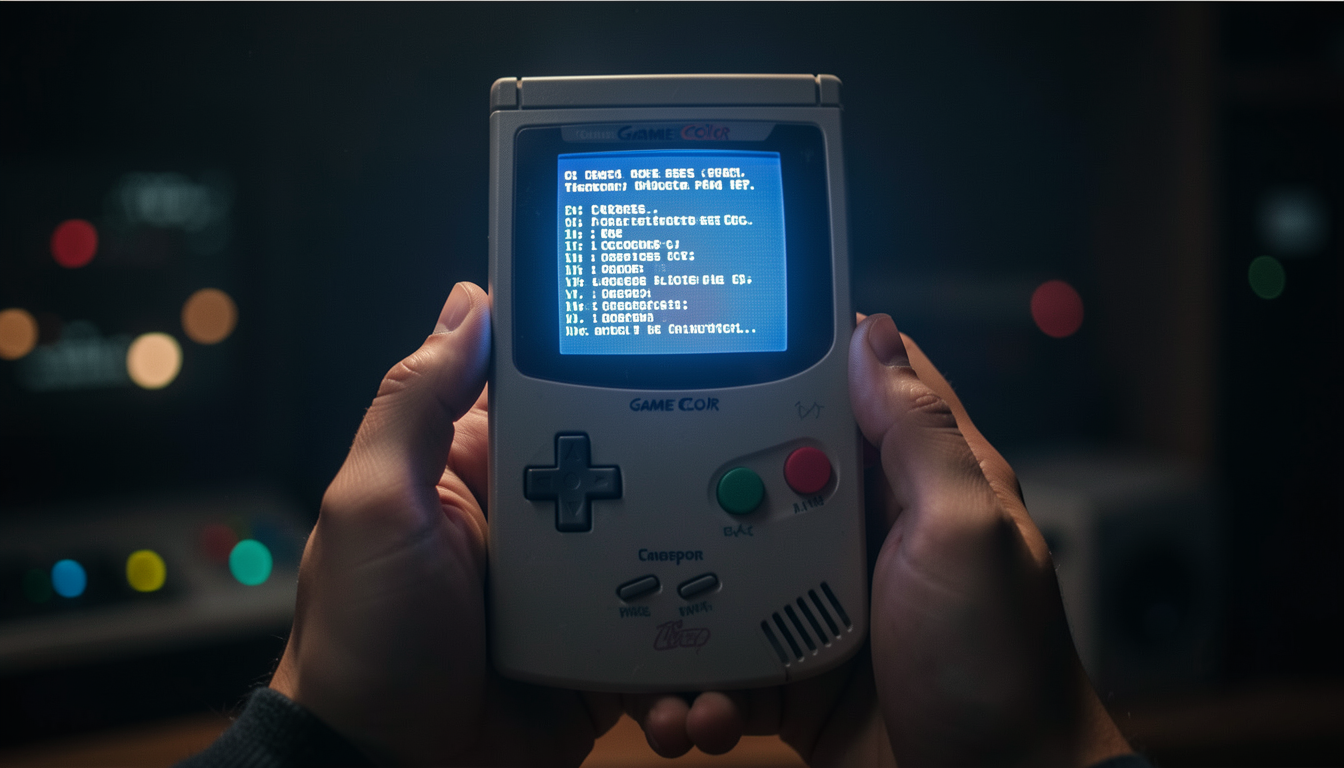

1998年に発売された「ゲームボーイカラー」。この懐かしい8ビットCPUを搭載したデバイスで、現代のAI技術の象徴である「Transformerモデル」が動作しているというニュースが世界中のエンジニアを驚愕させています。

最新のReddit調査によると、このプロジェクトはRedditのコミュニティにて大きな注目を集めています(参照: I got a real Transformer language model running on a real GameBoy Color)。単なるジョークではなく、実際にハードウェアの制約と戦いながら推論を行っている点に、エンジニアリングの真髄が隠されています。

なぜゲームボーイでAIなのか?

通常、LLM(大規模言語モデル)の動作には現代の高性能なGPUや大量のメモリが必要です。しかし、今回使用されたのはTinyStoriesと呼ばれる軽量モデルをさらに圧縮・変換したものです。浮動小数点演算を一切使用せず、固定小数点のみで計算を完結させるという手法が、この「狂気」とも言える実装を支えています。

実用性か、それとも芸術か

1,650円

楽天で見る ›結論から言えば、この実装に実用性はありません。1トークンの生成に3分を要するため、まともな会話を行うには気の遠くなるような忍耐が必要です。しかし、この試みは「いかにリソースを削ぎ落とせるか」というソフトウェア最適化の究極的な指標を示しています。

- 挑戦したい人: 低レイヤーの最適化やCPU命令セットに深い関心があるエンジニア

- おすすめできる人: レトロハードウェアへの愛情とAI技術の境界を探究したい人

- 様子見でよい人: 実用的なチャットボットや高速なAI推論を求める人

比較と技術的考察

現代のAI環境と、今回のようなレトロ環境での推論を比較してみましょう。

| 項目 | 現代のGPU環境 | ゲームボーイカラー |

|---|---|---|

| 演算精度 | FP16/BF16/INT8 | 固定小数点 (INT/Custom) |

| 生成速度 | 数百トークン/秒 | 約0.005トークン/秒 (3分/トークン) |

| メモリ | 数十GB | 数十KB(カートリッジ容量依存) |

| 目的 | 生産性・実用性 | 技術的実証・好奇心 |

まとめ:技術の核心を学ぶ

今回の実験は、スペックが低いからといって諦める必要はないというメッセージです。工夫次第で、私たちの手元にある古い機体にも最新のAI技術を宿らせることは可能です。もしあなたが、ハードウェアとソフトウェアの境界線で遊ぶのが好きなら、ぜひ関連プロジェクトのコードを覗いてみてください。

この試みは、今後の「超軽量LLM」がマイコンやIoTデバイスに普及する未来の先駆けとなるでしょう。

よくある質問(FAQ)

Q. ゲームボーイカラーで本当にAIが動くのですか?

A. はい、動作します。ただし、実用的な対話AIではなく、極限まで軽量化されたモデルをカートリッジ内に収め、数分かけて1トークンを出力する実験的な実装です。

Q. なぜそんな古いハードで動かす必要があるのでしょうか?

A. 実用性ではなく、技術的な限界への挑戦が目的です。古いCPUで現代のTransformerモデルをどう最適化できるかという核心的な工学課題を学べるからです。

Q. 自分で試すことはできますか?

A. 非常に高度な知識が必要です。固定小数点演算の実装やメモリ管理、アセンブラの知識が不可欠ですが、GitHub等で公開されている検証コードを参考にすることは可能です。

まずはRedditの元スレッドを読み込み、どのような最適化手法が取られたのかを確認することから始めてみてください。

✅ 今すぐ購入できます

Lazos microSDカード 32GB

★★★★☆ 4.55(146件のレビュー)

1,650円(税込)

🛒 楽天市場で詳細を見る ›※価格・在庫は変動するため、楽天市場のページにてご確認ください。

あわせて読みたい関連記事

おすすめ MPCでローカルLLMを無料AIエージェント化する手法

💡 今回の記事で学んだ「モデルを極限まで軽量化しローカルで動かす」という技術は、まさにこの記事で紹介している自律型AIエージェント構築の基盤となる知識です。リソースの制約を逆手に取った構築スキルを、ぜひ実践レベルへと昇華させてみてください。

コメント