- 🚀 PrismMLが発表した「1-bit Bonsai」は、パラメーター数8Bでありながらメモリ消費わずか1.15GBを実現。

- 🚀 従来モデルの14倍のメモリ効率を誇り、iPhoneなどのモバイル環境でもローカルLLMが快適に動作可能。

- 🚀 エッジAIの新たな革命となり得るモデルだが、複雑な推論タスクにおける性能検証は今後が注目される。

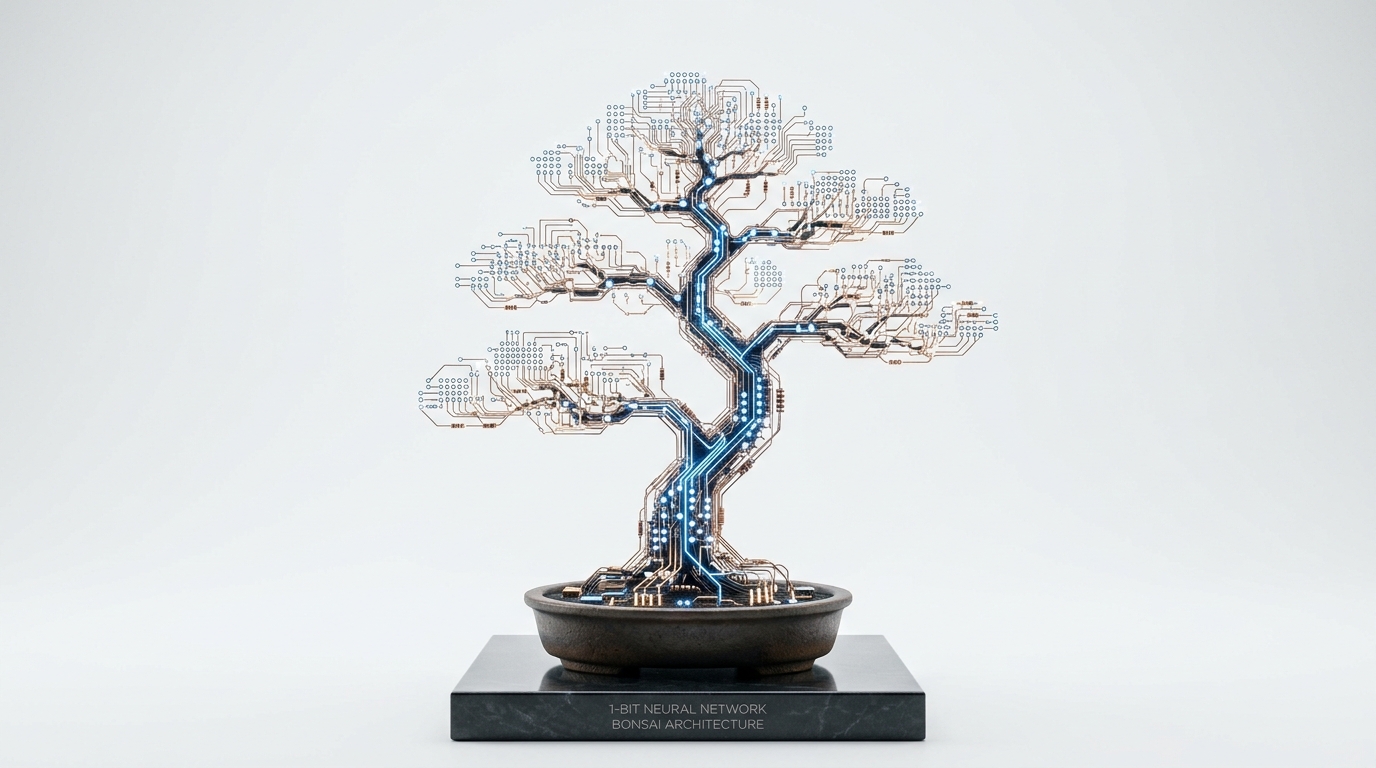

AIの進化速度は留まるところを知りませんが、ハードウェアリソースの制限は常に開発者やユーザーにとってのボトルネックでした。そんな中、画期的なニュースが飛び込んできました。GIGAZINEが報じた「1-bit Bonsai」という新しいAIモデルが、業界の常識を覆そうとしています。

このモデルは、パラメーター数が80億(8B)という、現代のLLMとしては中規模のサイズでありながら、驚くべきことに稼働に必要なメモリ消費量はわずか1.15GBという極限の最適化を達成しました。

メモリ消費量14倍のモデルと同等の性能

「1-bit Bonsai」の真に恐るべき点は、ただ軽いだけではないという点です。同等のパラメーター数を持つ従来のモデルと比較して、メモリ消費量は実に14分の1以下。それでありながら、ベンチマークテストでは同等以上の性能を叩き出しています。

これは、単なる量子化技術の延長ではなく、モデル構造そのものに「1ビット」という極限まで圧縮された情報を効率的に伝播させるアルゴリズムが採用されているためです。これまで、モデルを軽量化すれば性能(知能)が犠牲になるというのが定石でしたが、このモデルはその壁を打ち破りました。

iPhone 17 Pro MaxでローカルAIが日常に

この軽量化が意味するのは、クラウドに頼ることなく、iPhone 17 Pro Maxのようなモバイル端末上で高度なAIがローカル動作するという未来の実現です。プライバシー保護の観点からも、インターネット接続なしで推論が完結するローカルAIは非常に価値が高いものです。

今までは「AIを動かすにはゲーミングPCが必要」という認識がありましたが、今後はスマホが個人の専属AI執事として常駐する環境が標準となるかもしれません。

今後の課題と期待

もちろん、すべてが解決されたわけではありません。GIGAZINEの記事でも触れられている通り、非常に複雑な論理的推論や高度なマルチモーダル処理における挙動については、まだ未知数な部分も多くあります。

しかし、技術開発はまだ初期段階です。この「Bonsai(盆栽)」という名前が示す通り、小さく、しかし深く育て上げられたこの技術が、どのようにエッジAIの歴史を変えていくのか。Nexistixでは今後もPrismML社の動向を注視していきます。

今回の技術革新について、あなたはどう感じましたか?ぜひ皆さんの考えをSNSでシェアして、議論を盛り上げてください。また、最新のテック情報や詳細な解析記事は、当ブログのトップページから常に確認できるようにブックマークしておくことをおすすめします。

📣 この記事を読んだ方に特におすすめのアイテムです

あわせて読みたい関連記事

おすすめ TurboQuantでLLM推論を8倍高速化!KVキャッシュ圧縮の衝撃

💡 「1-bit Bonsai」によるモデルの軽量化に加え、推論速度を劇的に高める「TurboQuant」の技術を併せて知ることで、ローカルAI環境の最適化がさらに加速します。ハードウェアの限界を突破したいなら必読です!

コメント